ニュース

» 2024年02月02日 16時30分 公開

リコーは、日本語の精度が高い130億パラメーターの「大規模言語モデル(LLM)」を開発した。顧客の業種や業務に合わせたカスタムLLMを2024年春より順次、クラウド環境で提供する。

「学習に利用するコーパスの選定」など、独自工夫を盛り込む

リコーは2024年1月、日本語の精度が高い130億パラメーターの「大規模言語モデル(LLM)」を開発したと発表した。顧客の業種や業務に合わせたカスタムLLMを2024年春より順次、クラウド環境で提供する。

リコーが開発したLLMは、Meta Platforms製「LLM Llama2-13B」をベースに、日本語と英語のオープンコーパスを追加学習させた。「学習に利用するコーパスの選定」や、「誤記や重複の修正などのデータクレンジング」「学習データの順序や割合を最適化するカリキュラム学習」など、リコー独自の工夫を盛り込んでいる。

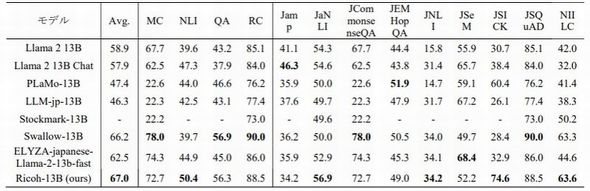

学習の結果、特にNLI(自然言語推論能力)に優れているという。日本語ベンチマークツール(llm-jp-eval)を用い、日本語LLMの性能を主なLLMモデルと比較したところ、リコーのLLMは評価スコアの平均値が最も高い(2024年1月4日現在)ことを確認した。

顧客は、リコーのLLMに独自の情報や知識を取り入れることで、それぞれの業務に適した独自のカスタムLLMを、短期間で容易に構築できるという。同LLMは、「AWS LLM開発支援プログラム」でサポートされており、「AWS Trainiumアクセラレーター」を搭載したAmazon Elastic Compute Cloud Trn1インスタンスを利用できる。これにより、従来手法による開発に比べ、「45%のコスト低減」や「12%の開発期間短縮」が可能となる。

関連記事

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

日本語精度が高い130億パラメーターのLLMを開発 - EE Times Japan

Read More

No comments:

Post a Comment